みなさん、こんにちは!👋

前回の第4章では、AIが「図書館への監禁」や「アメとムチのしつけ」といった、数百億円かけたスパルタ教育を受けて賢くなったお話をしました🏫

「あんなに厳しい教育を受けたなら、もうAIは完璧な優等生だね!」

そう思った方も多いかもしれません。

でも、こんな経験はありませんか?

ChatGPTに「キャッチコピーを考えて」とお願いして、微妙だったら「もう一回」と頼む。すると、さっきとは全然違う答えが返ってくる……🤔

もしAIがただの計算機(電卓)なら、こんなことは起きません。「1+1」は、何度計算しても「2」ですよね?

なぜAIは、毎回違うことを言うのでしょうか?

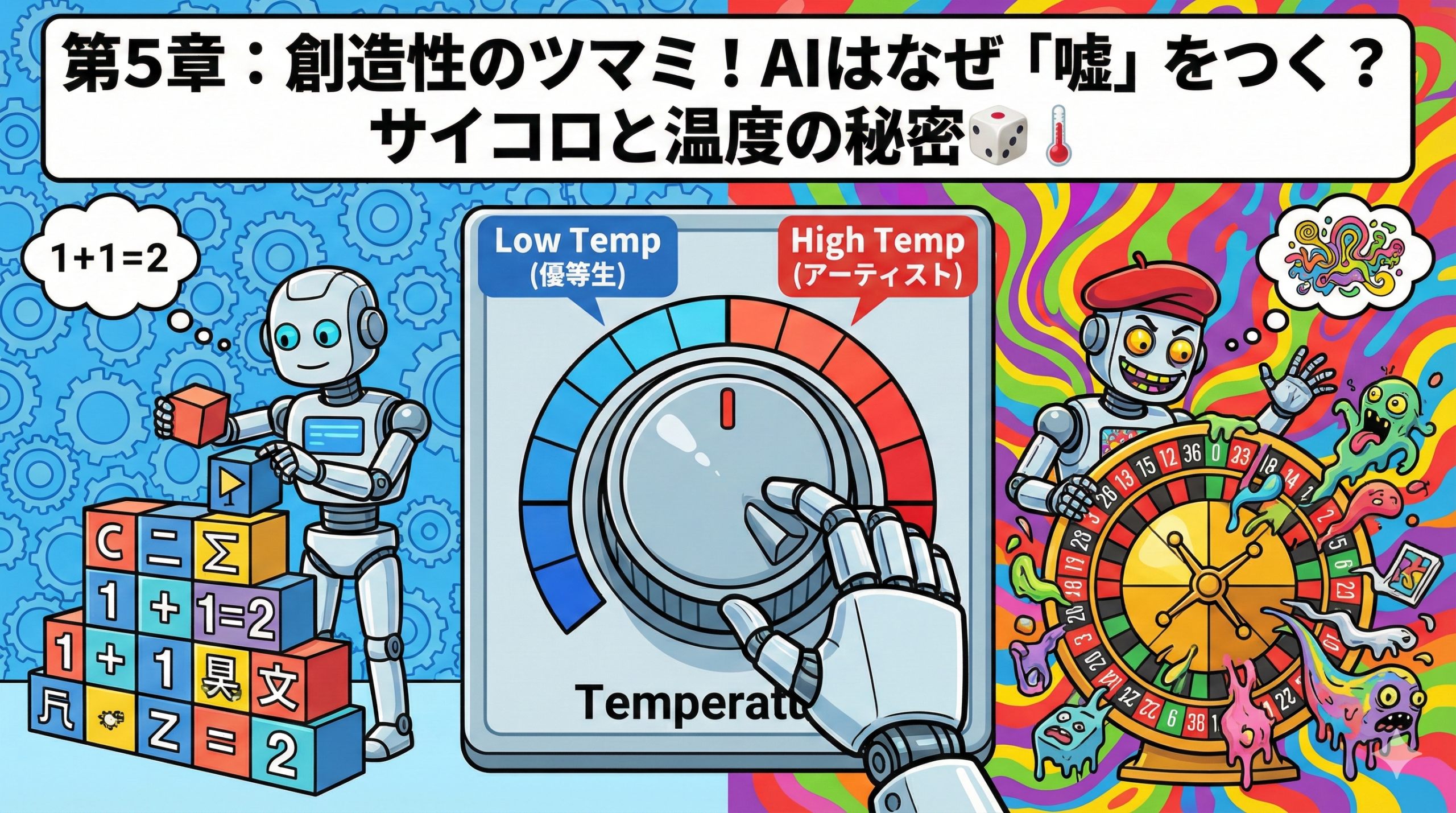

実は、AIの中身は計算機というよりも、巨大なサイコロを振るマシンに近いからなんです🎲

今日は、AIの性格をガラリと変えてしまう秘密のスイッチ、「温度(Temperature)」について解説します。

これを知ると、AIがたまにつく「もっともらしい嘘(ハルシネーション)」の正体も見えてきますよ!✨

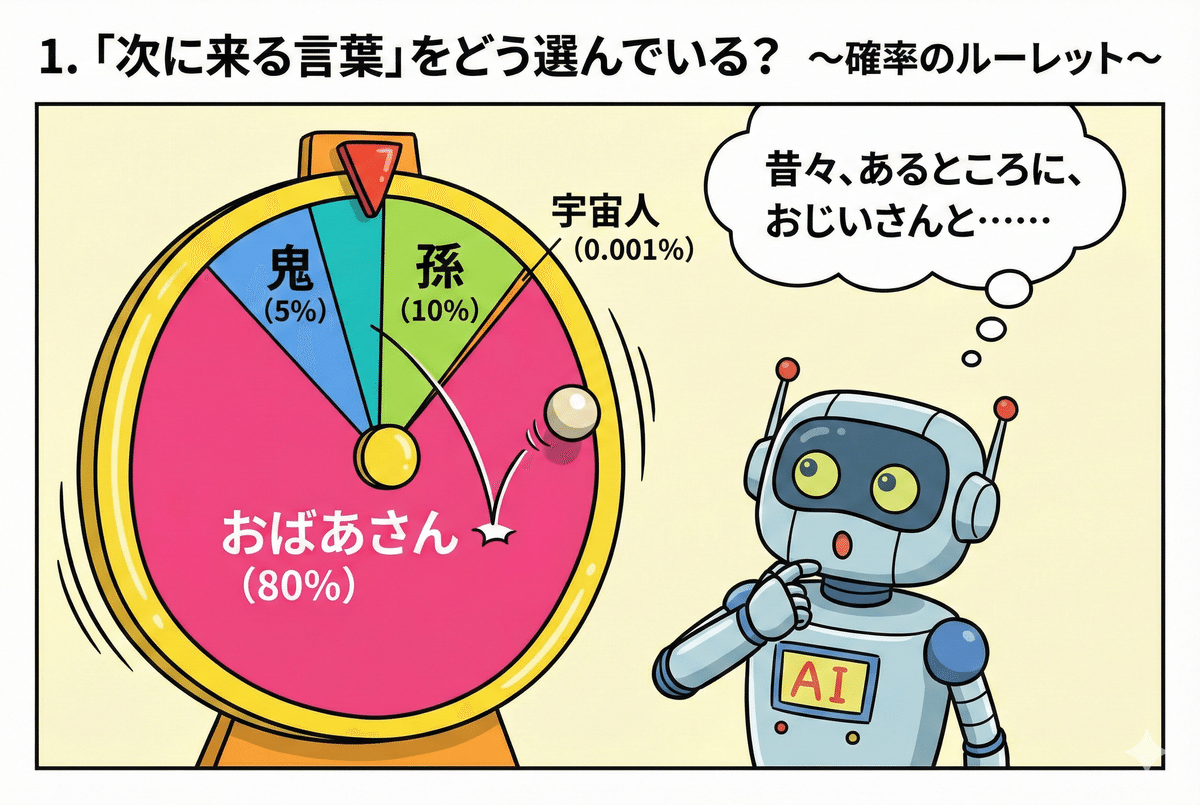

1. 「次に来る言葉」をどう選んでいる? 〜確率のルーレット〜 🎰

まず、AIが頭の中でどうやって文章を作っているのか、その現場を覗いてみましょう。

第2章で「AIは次に来る単語を予測している」というお話をしましたね。

例えば、「昔々、あるところに、おじいさんと……」という文章の続きをAIが考えるとします。

このとき、AIの脳内には、次に来そうな単語の候補リストが、確率が高い順にずらりと並んでいます。

・候補1位:「おばあさん」(確率 80%)

・候補2位:「孫」(確率 10%)

・候補3位:「鬼」(確率 5%)

・候補4位:「宇宙人」(確率 0.001%)

普通に考えれば、一番確率が高い「おばあさん」を選べば正解ですよね?

でも、AIの面白いところは、必ずしも1位を選ぶわけではないという点です😲

ここでAIは、ルーレットを回して運試しをします。

80%の確率で「おばあさん」に止まるかもしれないけれど、運によっては10%の「孫」や、5%の「鬼」に止まることだってあるんです!

もし毎回1位だけを選んでいたら、AIの文章はいつも金太郎飴のように同じになってしまい、面白みがありません。

あえて「確率による揺らぎ(ギャンブル)」を残しているからこそ、AIは人間のように表現豊かな文章を作れるのです🎨

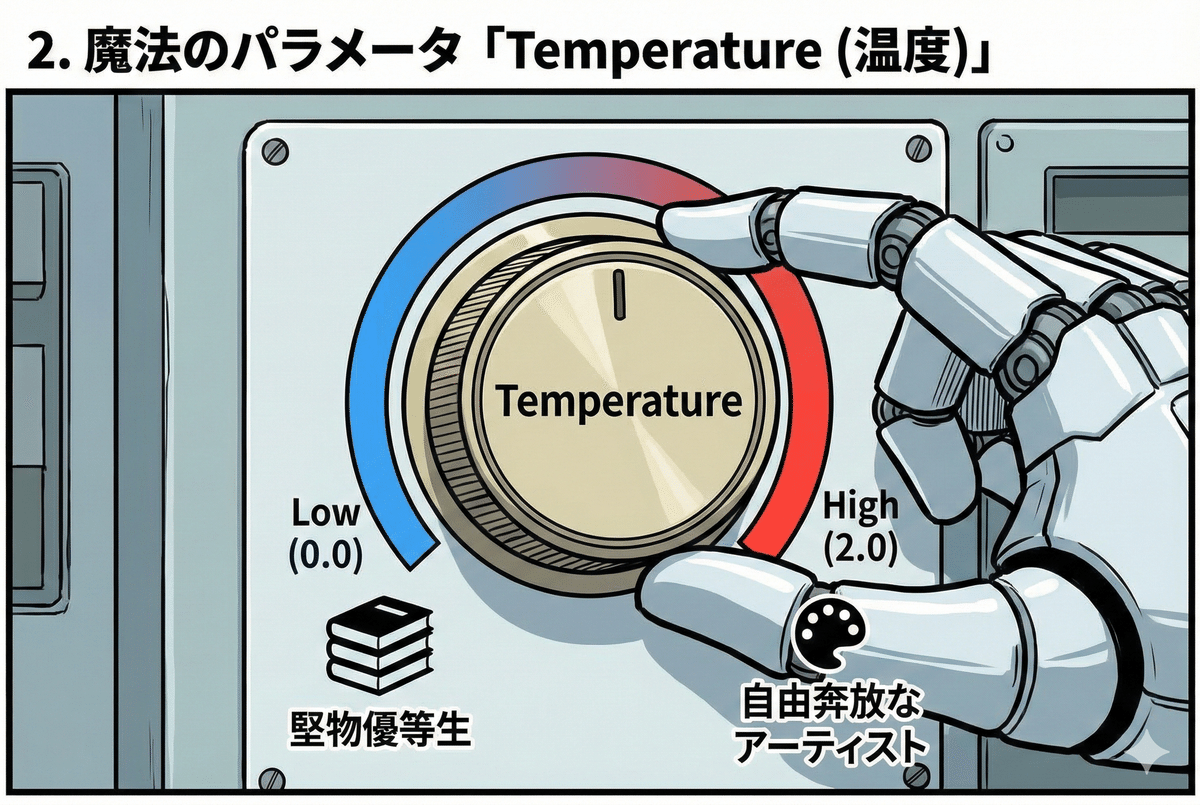

2. 魔法のパラメータ「Temperature(温度)」 🌡️

さて、ここで重要になるのが、今回の主役である「Temperature(温度)」というパラメータです。

これは、先ほどの「ルーレットの回し方」を調整するツマミのことです🎛️

一般的に、0.0から2.0くらいの間で設定できるのですが、この温度を変えるとAIの「性格」が劇的に変わります!

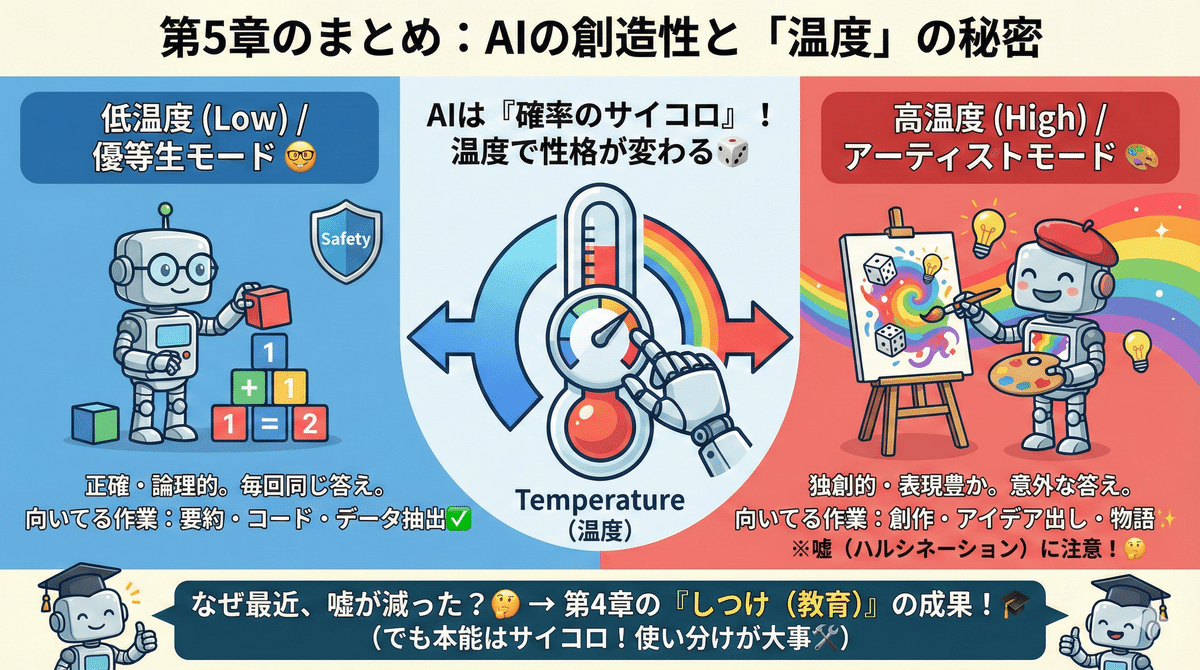

低温度(0.1〜0.3)=「ガチガチの堅物優等生」🤓

温度を低く設定すると、AIは冒険をしなくなります。

ルーレットの「1位」の面積が極端に広がり、ほぼ確実に一番安全な言葉だけを選ぶようになります。

・特徴:回答が正確で論理的。何度質問しても、判で押したように同じ答えが返ってきます。

・向いている作業:文章の要約、プログラミングのコード生成、データの抽出など、「正解」が欲しいとき。

高温度(0.8〜1.0以上)=「自由奔放なアーティスト」🎨

逆に温度を高くすると、AIは冒険家になります!

確率が低い「孫」や「鬼」、時には「宇宙人」といった意外な言葉も、あえて選択肢に残してルーレットを回します。

・特徴:回答が独創的で、表現が豊かになります。その代わり、たまに突飛すぎて話が通じなくなることも……。

・向いている作業:小説や脚本の執筆、新しいアイデア出し(ブレインストーミング)、キャッチコピー作成など、「意外性」が欲しいとき。

AIはただの機械ではなく、この「温度」によって、堅実な秘書にもなれば、自由な芸術家にもなれるのです🎭

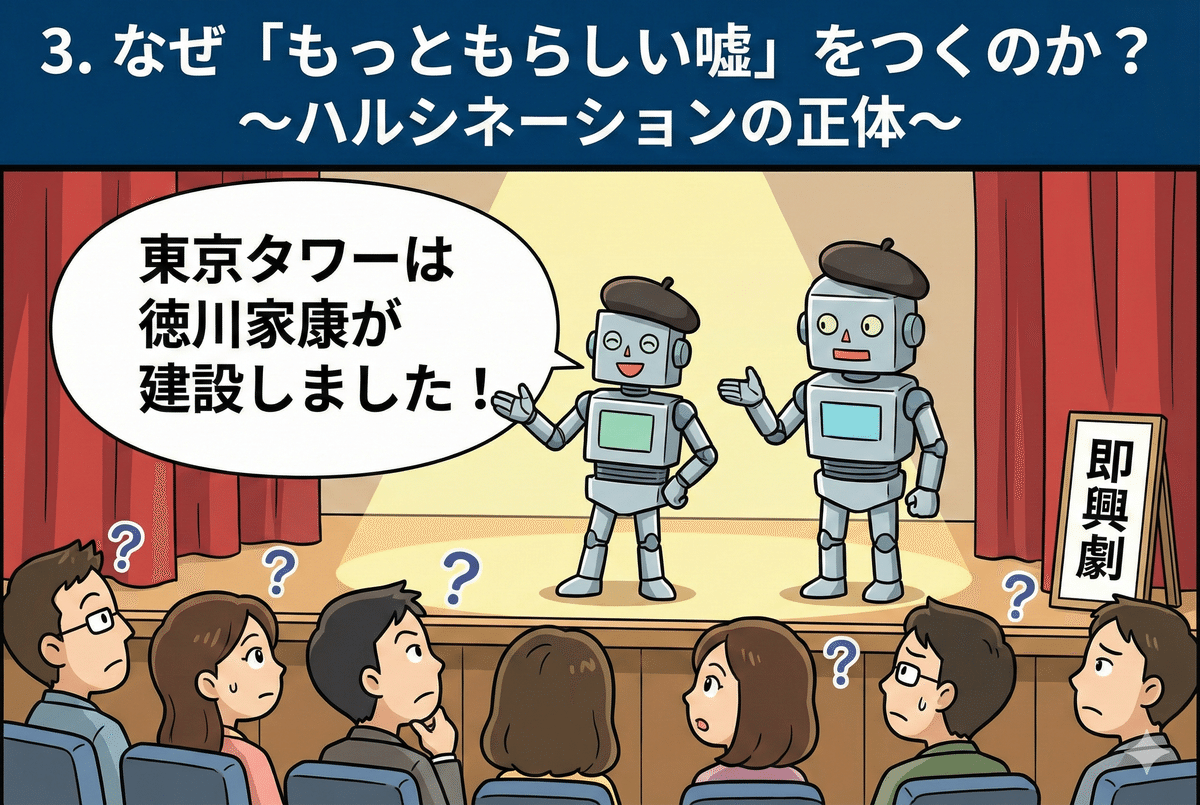

3. なぜ「もっともらしい嘘」をつくのか? 〜ハルシネーションの正体〜 🤥

ここで、AI最大の謎である「ハルシネーション(幻覚)」についてお話ししましょう。

AIが息を吐くように嘘をつく、あれです。

「東京タワーは、1603年に徳川家康が建設しました」

なんて嘘を、さも自信満々に言われたことはありませんか?💦

なぜこんなことが起きるのか。理由はもうお分かりですね。

AIが「確率」で言葉を選んでいるからです。

AIにとって重要なのは、「その情報が事実かどうか(True or False)」ではありません。

「文章として、確率的になめらかに繋がっているか(流暢さ)」だけが重要なのです。

例えるなら、舞台の上でセリフを忘れてしまった「即興劇の役者」のようなものです。

役者(AI)は考えます。

「セリフ忘れちゃった! でもここで黙ったら舞台が台無しだ。とりあえず、それっぽい言葉をつなげて、その場を乗り切ろう!」

そして、高温度のアーティストモードになっているAIは、確率の低い言葉もつなぎ合わせて、架空の歴史や物語を「創造」してしまいます。

つまり、ハルシネーションはAIのバグ(故障)ではありません。

「創造性」と引き換えに生まれてしまう、避けられない副作用なのです💊

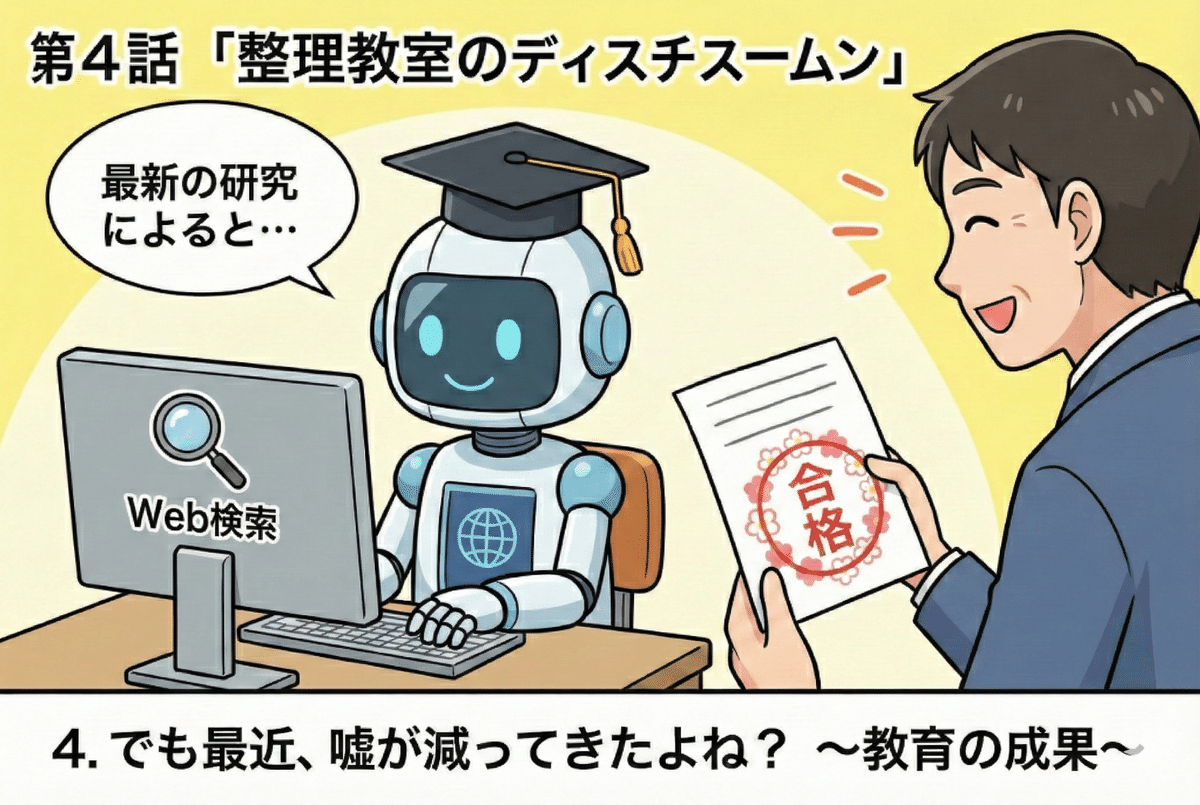

4. でも最近、嘘が減ってきたよね? 〜教育の成果〜 🎓

「あれ? でも最近のChatGPT(GPT-5.1、Gemini3.0)は、昔ほど変な嘘をつかなくなったよね?」

そう感じている方は鋭いです!👏

実はここ数年で、AIのハルシネーションは劇的に減っています。

なぜ「生まれつきのギャンブラー」であるAIが、嘘をつかなくなったのか?

ここで思い出してほしいのが、前回(第4章)で解説した「スパルタ教育」です!

理由①:「しつけ」が厳しくなったから(RLHF)

第4章でお話しした「アメとムチ」のしつけ教室を覚えていますか?

昔のAIは「面白ければOK」でしたが、今は「嘘をついたら低評価(おやつ抜き!)」という厳しい指導が行われています。

これにより、AIは「自信がないときは、適当に答えるのではなく『分かりません』と言った方が人間に褒められる」と学習しました。

教育の力ってすごいですね!🐕

理由②:「カンニング」が許されたから(RAG / 検索機能)

もう一つの理由は、AIがネット検索(ブラウジング)を使えるようになったことです。

昔は自分の記憶だけを頼りに答える「クローズドブック試験」でしたが、今は「ちょっとググってきますね」とカンニングすることが許されています。

うろ覚えの記憶で知ったかぶりをする必要がなくなったため、正確性が格段に上がりました🔍

つまり、AIは本能としては「確率で言葉を選ぶサイコロマシン」のままですが、後天的な「教育」と「便利な道具」によって、信頼できるパートナーへと進化している最中なのです🚀

5. まとめ:使い分けが大事! 🛠️

第5章のポイントをまとめておきましょう📝

1.AIは計算機ではなく、サイコロ(ルーレット)を回して言葉を選んでいる🎲

2.低温度(優等生)は正確さ重視、高温度(アーティスト)は創造性重視🎨

3.嘘をつくのはAIの仕様(創造性の副作用)だが、最近は第4章の「しつけ」のおかげでかなり改善された!

私たちがAIを使うときも、この「温度感」を意識するともっと上手に付き合えます。

正確な情報が欲しいときは、「事実に基づいて、論理的に教えて」と指示して、AIの脳内の温度を下げさせましょう。

逆に、面白いアイデアが欲しいときは、「クリエイティブに、意外性のある案を出して」と指示して、温度を上げてあげればいいのです🌡️

さて、ここまでで「言葉(テキスト)」を扱うAIの脳みその仕組みは、ほぼ完全に理解できましたね!

でも……最近のAIって、「目」で見たり、「耳」で聞いたり、絵を描いたりできますよね?

文字しか読めないはずのAIが、どうやって写真を見て「これは猫だ」と理解しているのでしょうか?

次回、第6章では「目と耳を持ったAI」の秘密に迫ります。

キーワードは、「画像をバラバラに切り刻む」!?🔪

AIの視覚の謎を解き明かしに行きましょう!

(次回予告)

第6章:目と耳を持ったAI ― マルチモーダルへの進化

〜画像を切り刻むAIと、言葉と絵をつなぐ架け橋〜

お楽しみに!👋

コメント