> Bambu Lab・Elegoo・CrealityのAI失敗検出から、MITが発表した「印刷前に仕上がりを予測するAI」VisiPrintまで。プリンター側に入り込むAIの最新動向をFusion歴10年以上の僕が整理しました。

👇 音声でも解説しています

👇 YouTube動画版はこちら

朝起きて3Dプリンターの前に行ったら、ノズルの周りがフィラメントのもじゃもじゃで鳥の巣みたいになっていた。8時間かけたはずのフィギュアが横に転がっていて、一晩分の時間とフィラメントが全部無駄。

3Dプリンターを使ったことがある方なら、一度は味わったことのある絶望だと思うんですよね。

こんにちは、まーです!

今日のテーマは「プリント失敗をAIが自動で見つけてくれる時代」です。2026年の今、プリンター側がこの失敗を「自分で気づいて」止めてくれる流れが本格的に来ています。しかも2026年4月、MITからはさらに一歩進んだ「印刷する前に仕上がりを予測するAI」まで発表されました。

今日はこの最新動向を、Fusion歴10年以上の僕の目線で、メーカー別の比較から未来予測まで一気に整理します。

- まず「失敗あるある」4選 ─ なぜAI監視が必要なのか

- Bambu Lab X1 Carbon ─ 業界の先頭を走る本体組み込みAI

- スパゲッティ検出はどうやって動いているのか

- A1 miniはどうなの? ─ クラウド連携という選択肢

- Elegoo Centauri Carbon 2 ─ クラウド側AIと組む戦略

- OctoEverywhere ─ クラウドAI監視という第3の選択肢

- Creality Hi ─ ノズルセンサーとカメラAIの組み合わせ

- MIT VisiPrint ─ 印刷する前に仕上がりを予測するAI

- VisiPrintの仕組み ─ 2つのAIが連携する

- VisiPrintで何ができるようになるのか

- 「3Dプリントの3分の1が捨てられている」問題

- AI×3Dプリントの未来予測 ─ 監視・予測・最適化・生成

- Z世代のAI自作ブームが市場を動かす

- まとめ ─ AIが変える3Dプリントの3つのこと

- 今回紹介した製品

- 関連記事

- 画像挿入マップ(編集用メモ)

まず「失敗あるある」4選 ─ なぜAI監視が必要なのか

3Dプリンターの失敗には、いくつか代表的なパターンがあります。

①「スパゲッティ状態」。造形物がベッドから外れて、ノズルが宙を動きながらフィラメントを吐き続けて、プリンター内が糸だらけになる現象です。一番有名な失敗で、かつ一番被害が大きい。

②「レイヤーシフト」。途中で軸がカクンとずれて、上下でモデルの位置がズレる事故です。ベルトの緩みや、ヘッドがどこかに衝突した時に起きます。

③「ベッド剥がれ」。最初の数層でベッドに定着しなかった造形物が、途中で剥がれて引きずられていく。

④「ノズル詰まり」。押し出し量が足りなくなって、いわゆる空打ちになる現象です。

この4つに共通するのは「早く気づけば被害が小さい、気づかないと致命的」ということ。

寝ている間、出かけている間、この「気づかない時間」が長いほど損失が膨らんでいくんですよね。僕も過去に、深夜に走らせた8時間プリントが開始30分でベッド剥がれしてて、朝見たら鳥の巣ができてた、みたいなことが何度かあります。一晩分のフィラメントと時間と、あと精神的ダメージが大きい。

ここに、AIが本格的に切り込んできたわけです。

Bambu Lab X1 Carbon ─ 業界の先頭を走る本体組み込みAI

業界の先頭を走っているのがBambu LabのX1 Carbonです。

本体に高性能カメラが内蔵されていて、プリント中は造形物をずっと観察し続けています。そしてここにAIが2段構えで入っています。

1つ目が「スパゲッティ検出」。糸だらけ事故をカメラの画像解析で判定してくれます。

2つ目、そしてX1 Carbonの目玉が「LiDARによる第1層スキャン」。ノズル横のLiDARセンサーが1層目を印刷した直後にベッド全体をスキャンして、スライサーが予想している形状と、実際に印刷された形状を比較する仕組みです。ここで剥がれや厚みムラがあればプリンターが自動で検出して、一時停止→スマホアプリに通知、という流れになります。

「寝ている間に失敗して朝起きたら悲劇」というあの展開を、構造的に防ぐ設計なんですよね。本体の中にAIとセンサーが組み込まれていて、クラウドに頼らなくても本体だけで判定が完結するというのが、X1 Carbonの強みだと思います。

スパゲッティ検出はどうやって動いているのか

ここで少しだけ、AI監視の仕組みを掘り下げます。

やっていることは意外とシンプルで、「カメラで見た今の造形物の画像」と「AIが学習している正常な造形パターン」を比較しているんです。AI側は、大量のスパゲッティ事故の映像で事前に学習されていて、確信度が一定以上になると「これは失敗です」と判定して、プリンターが一時停止する仕組みです。

ポイントは2つあります。

①AIは完璧ではありません。誤検知、つまり正常に印刷できているのに「失敗だ」と判断する偽陽性もあれば、逆に本当は失敗しているのに見逃す偽陰性もあります。

②それでも、人間の目に比べれば圧倒的に早くて正確です。寝ている8時間、人間は絶対に気づけませんけど、AIは毎秒見張ってくれる。

この「時間の武器」がAI監視の本質的な価値なんだと思います。24時間365日、疲れずに、集中力を落とさずに見張ってくれる監視員。これが各メーカーの標準装備になってきているわけです。

A1 miniはどうなの? ─ クラウド連携という選択肢

A1 miniユーザーの方、一番気になるのは「で、A1 miniはどうなの?」ですよね。

正直にお伝えすると、A1 miniにはカメラは搭載されていますが、X1 Carbonのような本体組み込みのAI失敗検出機能は、2026年4月時点では公式に提供されていません。

A1 miniのカメラはタイムラプス撮影と、Bambu Handyアプリからのライブモニタリングが主な用途で、スパゲッティ検出のような自動判定はBambu純正としては未搭載なんです。

じゃあA1 miniユーザーはあきらめるしかないのか、というと、そうじゃないんですよね。クラウドサービスとの連携という選択肢があります。それが次に紹介する「OctoEverywhere」です。

Elegoo Centauri Carbon 2 ─ クラウド側AIと組む戦略

次にElegoo Centauri Carbon 2、略してCC2です。

ElegooはもともとLCD方式の光造形機で有名なメーカーですけど、CC2はFDM機の中でもフラッグシップ機として出てきた機種です。

CC2のAI検出もカメラベースで、スパゲッティやベッド密着不良などを検知します。ここが興味深いポイントで、CC2のAI検出はElegoo自社開発というよりも、OctoEverywhereの「Gadget」というサービスと連携する形で提供されているんですね。つまり、クラウド側のAIに画像を送って判定してもらう仕組みです。

Elegoo独自のポイントはMatrixアプリとの連携で、複数のプリンターを1画面で管理できます。工房とか、プリンターを複数持っている方には便利な機能だと思います。

ただCC2のAI検出は、偽陽性が多めという声もあって、完成度という意味ではまだBambu系に一歩譲る印象です。ここは今後のアップデートで磨かれていく部分ですね。

OctoEverywhere ─ クラウドAI監視という第3の選択肢

ここで詳しくOctoEverywhereを紹介します。

3Dプリンター用のクラウド監視サービスで、日本ではまだ知名度がそこまで高くないんですけど、世界ではかなり使われているサービスなんです。

仕組みはこうです。プリンターに接続したカメラの映像を、自宅のWi-Fi経由でOctoEverywhereのクラウドに送ります。クラウド側に「Gadget」というサービスがあって、そこがその映像を受け取ってプリント失敗を検知してくれる。

つまり、自前のAI監視が弱いプリンターでも、OctoEverywhereに接続すればクラウド側のAIで監視してもらえるわけです。

対応プリンターが幅広くて、OctoPrint系、Klipper系、Bambu LabやElegooの一部機種、本当にいろいろ繋がります。月額無料プランもあって、まずは試すハードルが低いのもいいところです。

特にA1 miniユーザーで「外出先からもしっかり監視したい」という方は、一度調べてみてほしいサービスです。本体機能にないものをクラウドで補う、という発想は、これから増えていくんだろうなと思います。

Creality Hi ─ ノズルセンサーとカメラAIの組み合わせ

Crealityからも興味深い動きが出ています。

新機種の「Creality Hi」には、LiDARではなく、AI対応の高感度ひずみゲージ式ノズルが搭載されています。ノズル側のセンサーがベッドとの接触圧力をマイクロレベルで検知して、レベリング精度を上げる仕組みです。

さらにカメラ映像と組み合わせた失敗検出も搭載されていて、スパゲッティなどの異常をAIが判定します。

CrealityはLiDARに頼らず、ノズル側センサーとカメラAIの組み合わせで勝負しに来ている形なんですよね。

整理すると、①Bambuは本体組み込みAI+LiDAR、②ElegooはOctoEverywhere連携、③Crealityはノズルセンサーとカメラの統合。

どの方向が最終的に勝つかはまだ誰にもわかりませんけど、「プリンター側が失敗を見つけて止める」というコンセプト自体は、完全に業界の標準装備になりつつあります。

MIT VisiPrint ─ 印刷する前に仕上がりを予測するAI

ここからが今日のクライマックスです。

MITが2026年4月に発表した「VisiPrint」という新技術。これまで紹介してきたAI機能は全部「プリント中の失敗を見つける」、いわゆる事後検出型のAIでした。

VisiPrintは、この発想を完全に逆転させているんですよね。「印刷する前に、仕上がりがどうなるかを予測する」AIなんです。

具体的な使い方を説明します。スライサーで生成したスライスパターンのスクリーンショットと、使用するフィラメントの材料写真、この2つを入力として渡します。そうすると、VisiPrintが「完成品がこう見えますよ」という予測画像を生成してくれる。

しかも、単なるレンダリングじゃないんです。材料特性やスライス設定を総合的に考慮した「実物に近い見た目」を生成してくれる、というのがミソです。

印刷する前に「これ、本当に思った通りのものが出るのか?」を画面上で確認できる。試作の回数を減らせて、フィラメントの無駄を激減させられる可能性がある。発想を根本から変える新技術だと思います。

VisiPrintの仕組み ─ 2つのAIが連携する

仕組みをもう少しだけ詳しく話します。

VisiPrintの内部では、2つのAIが連携しています。

1つ目はコンピュータビジョンモデルです。「材料の画像」を受け取って、透明度、光沢、色の出方、表面テクスチャといった特性を数値化します。同じ白いPLAでもツヤありとツヤなしでは仕上がりが全然違いますよね。人間はこの違いを経験で知っていますけど、VisiPrintは画像から自動で読み取るわけです。

2つ目が生成AIモデル。1つ目が抽出した材料特性と、スライスパターン、モデルのジオメトリ情報、この3つを統合して、完成品の見た目を画像として生成します。

単に「きれいな予想図」を出すんじゃなくて、レイヤーラインの見え方、エッジの鋭さ、材質感まで予測している点が重要だと思います。ACM CHI 2026という学会で正式発表される予定です。

VisiPrintで何ができるようになるのか

応用分野はすでにいくつか示されています。

①歯科分野。歯科医さんが仮歯をプリントする前に、患者さんの歯の色や質感に合うかを事前確認できる。これまでは装着してから「色が合わない」と気づいて作り直す、というパターンが多かったそうなんですけど、そこが大きく変わります。

②建築模型。材料や照明条件を変えて何パターンも作る代わりに、画面上で完成予想を確認してから「本当に作るべき1パターン」だけを印刷すればよくなります。

③プロトタイプの試作回数削減。「このフィラメントでこの形状を印刷したら、本当に思ったような質感になるのか」を印刷前に確認できる。

これ、僕が一番ありがたいと思った応用です。毎週のようにテスト印刷でフィラメントを消費していく身としては、事前に「これはいける」とわかるだけでも、すごく大きい。

「3Dプリントの3分の1が捨てられている」問題

VisiPrintの背景には、ちょっと衝撃的な数字があります。

MITの研究チームが引用している調査によると、3Dプリントで使われた材料のおよそ3分の1が、試作や失敗で最終的に無駄になっている、という見積もりがあるんです。

3分の1ですよ。

印刷ミス、思ったのと違う仕上がり、色や質感が合わない、サイズがちょっと違った。そういう「無駄な印刷」が業界全体で大量に発生している現実があるんですね。

これは環境負荷の話でもあります。PLAは生分解性と言われますけど、一般環境では分解されにくいし、PETGやABSは言うまでもありません。「気軽に印刷して気軽に捨てる」文化が、結果的にかなりのプラスチック廃棄を生んでいるわけです。

VisiPrintのような事前予測技術は、この無駄を根本から減らす可能性を持っている。単なる便利ツールじゃなくて、業界の持続可能性にも繋がる話だと僕は思います。

AI×3Dプリントの未来予測 ─ 監視・予測・最適化・生成

ここから僕の考えを話します。

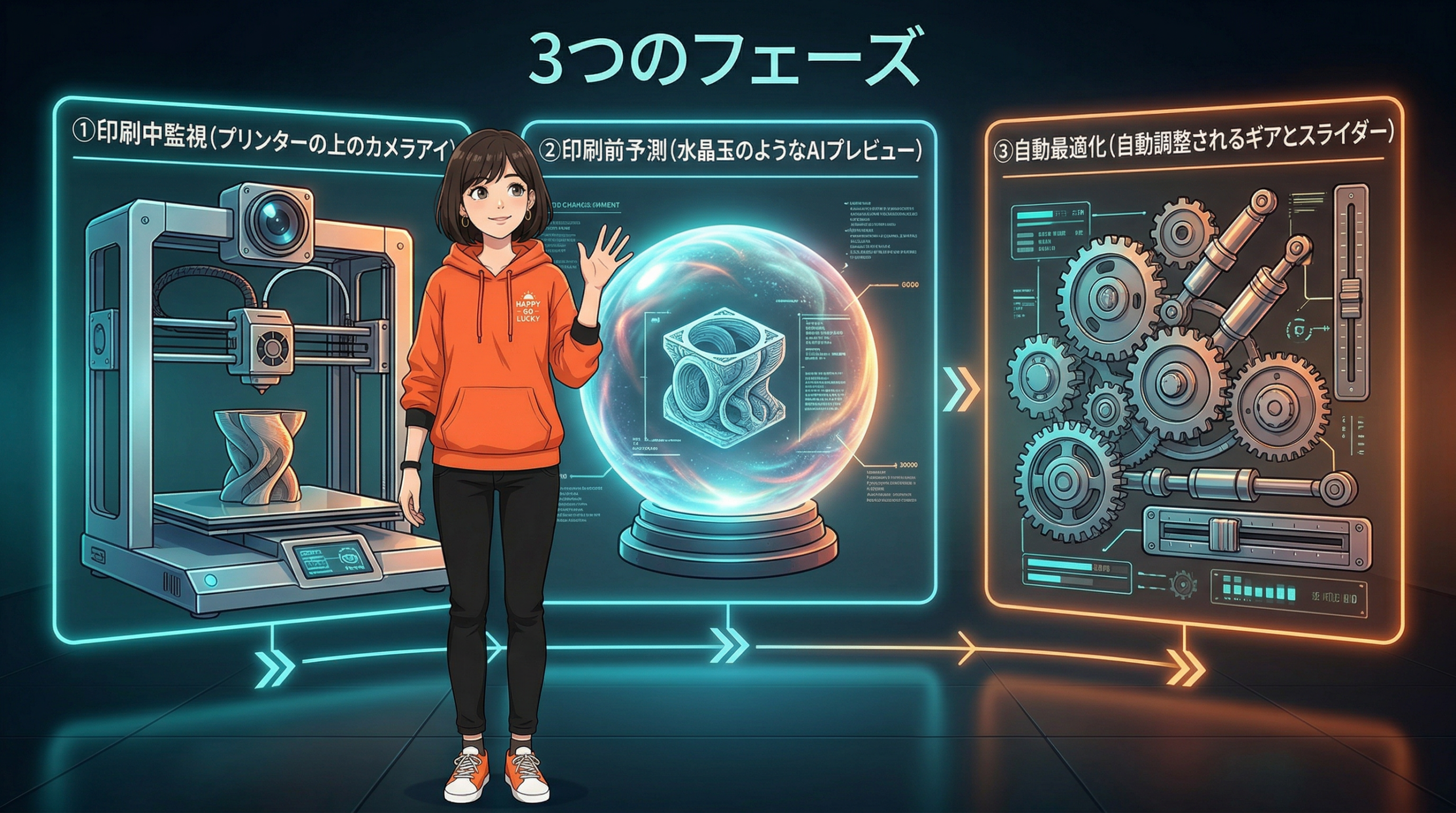

AIは今、3Dプリントの2つのフェーズにがっつり入り込んでいます。

①「印刷中の監視」。Bambu・Elegoo・CrealityのAI失敗検出。

②「印刷前の予測」。MITのVisiPrint。

そしておそらく数年以内に3つ目のフェーズ、「AIによるプリント条件の自動最適化」が来ます。材料、形状、環境温度、ノズル状態を全部AIが読み取って、ベストな速度、温度、リトラクション値を自動で決める。プロファイル調整という作業自体がなくなっていく可能性があると思うんですよね。

そしてもう1つ、モデルを作る側にもAIはすでに入ってきています。写真1枚からMakerWorldのAI機能でブラウザ内で3Dモデルが作れるという話や、Claude Codeみたいなコーディングエージェントに直接CADコードを書かせて娘のおもちゃを作った体験談、どちらも別動画でまとめているので、気になる方は関連動画からどうぞ。

「モデルを作る側のAI」と「プリンター側のAI」、両方が並行で進化していて、両方とも日常の一部になりつつあるのが2026年という時代だと思います。

生成から監視、予測、最適化まで、あらゆる工程にAIが入り込んでいく。5年後の3Dプリンターは「置いて、画像を渡して、帰ってきたら完成している」くらいの体験になっているんじゃないかな、と思っています。

Z世代のAI自作ブームが市場を動かす

この未来予測を後押ししているのがZ世代の自作ブームです。

TikTokでは3Dプリント自作のキーホルダーやフィギュアの動画がバズっていて、数千万再生を超えるヒット動画も出てきています。

共通点は「CADを覚えていない」ことなんですよね。スマホ世代の彼らはFusion 360を触らず、スマホで写真を撮ってAIで3D化して、プリンターに送る、というフローを当たり前のように使っています。

3Dプリント人口のピラミッドが、下から一気に広がってきているんです。

この新しいユーザー層は「失敗したくない」「調整したくない」「すぐに結果が欲しい」というニーズが強くて、AI監視やAI予測の一番の顧客になります。

メーカー側もここを狙っていて、ここ1〜2年の新機種発表では必ず「AI」「自動化」「失敗検出」を前面に出すようになりました。技術トレンドとユーザートレンドが一致している今、業界が一気に動く瞬間にいるんだと思います。

まとめ ─ AIが変える3Dプリントの3つのこと

今日の話をまとめます。

AIは3Dプリントに、2つの方向から入り込んでいます。

①「印刷中の監視」。Bambu LabのX1 Carbon、ElegooのCC2、Creality Hi。各社がカメラとセンサーでスパゲッティ検出や第1層検査を自動化しています。OctoEverywhereのようなクラウドサービスを使えば、A1 miniのような自前AIが未搭載の機種でもクラウド側のAIで監視してもらえます。

②「印刷前の予測」。MITのVisiPrintが示した方向で、仕上がりを事前に予測することで試作回数を劇的に減らせる可能性があります。

そして数年以内に「自動最適化」が3つ目のフェーズとして来るはずです。監視、予測、最適化、生成まで、全工程にAIが入った道具に、3Dプリンターはどんどん近づいていきます。

特にA1 miniユーザーの方への実践的なメッセージとしては、Bambu Handyの通知を有効にして、OctoEverywhereを組み合わせてみるだけで、「気づけない8時間」が「気づける8時間」に変わります。まずはそこからでも十分効果があると思います。

今日の動画が参考になったら、チャンネル登録とコメントをぜひお願いします。コメントで聞きたいことが2つあります。①「プリント失敗で一番ショックだった思い出」、②「AI監視機能で助かった話」。「夜中に通知が来て被害が最小で済んだ」みたいな体験談、ぜひ教えてください。

このチャンネルでは、Bambu LabのA1 miniなどの3Dプリンターを中心とした技術などを毎日更新でお伝えしてます、ではまた次回、お会いしましょう、まーでした。

今回紹介した製品

- Bambu Lab A1 mini ─ 本チャンネルのメイン機。Bambu Handyアプリとの連携で通知監視が可能

- Bambu Lab X1 Carbon ─ LiDAR+本体組み込みAIでスパゲッティ検出・第1層スキャンを自動化(公式ストア)

- Elegoo Centauri Carbon 2 ─ OctoEverywhere連携でクラウド側AIによる失敗検出

- Creality Hi ─ AI対応ひずみゲージ式ノズル+カメラAIの組み合わせ

関連記事

- Claude Codeで3Dモデルを作ってみた ─ Fusion歴10年以上の僕が「もうCAD開かなくていいかも」と思った日 ─ モデルを作る側のAI体験記

- MakerWorldで写真から3Dプリント!CADなしでも始められるAI機能を徹底解説 ─ 写真1枚でプリント可能なモデルが出来上がる時代の入門

- インフィルパターン本気比較!ジャイロイド vs グリッド vs ハニカム【前編】 ─ 強度と時間のバランス設定

- 仕上げの極意・後編 ― 糸引きとフローを極める ─ プリント後の仕上げテクニック

※ この記事にはAmazonアソシエイトリンクを含みます。購入いただくと、活動の支援になります。

👇 音声でも解説しています

👇 YouTube動画版はこちら

👇 ブログ記事(テキスト版)

👇 Note(テキストでじっくり読みたい方)

画像挿入マップ(編集用メモ)

| 位置 | 画像 | 対応Slide | 内容 |

|——|——|———-|——|

| 冒頭 | scene/001.png | Slide 1 | スパゲッティ失敗の朝の絶望(アイキャッチ) |

| 失敗あるある | scene/004.png | Slide 4 | 失敗4選(スパゲッティ・シフト・剥がれ・詰まり) |

| X1 Carbon | scene/005.png | Slide 5 | X1 CarbonのカメラとLiDARセンサー |

| スパゲッティ検出 | scene/006.png | Slide 6 | AIがカメラ映像と正常パターンを比較する図 |

| A1 mini | scene/007.png | Slide 7 | A1 miniのカメラとBambu Handy通知 |

| CC2 | scene/008.png | Slide 8 | Elegoo CC2+Matrixアプリ画面 |

| OctoEverywhere | scene/009.png | Slide 9 | プリンター→クラウドGadget監視の構成図 |

| Creality Hi | scene/010.png | Slide 10 | Creality Hiのノズルひずみゲージ+カメラ |

| VisiPrint登場 | scene/011.png | Slide 11 | 印刷前にPCで仕上がり予測を確認する図 |

| 2つのAI | scene/012.png | Slide 12 | コンピュータビジョン+生成AIの連携図 |

| 応用分野 | scene/013.png | Slide 13 | 歯科・建築模型・プロトタイプ試作の3分野 |

| 3分の1問題 | scene/014.png | Slide 14 | 無駄廃棄フィラメントの山のイメージ |

| 未来予測 | scene/015.png | Slide 15 | 監視・予測・最適化・生成の4象限図 |

| Z世代 | scene/016.png | Slide 16 | スマホ世代のAI自作ブーム |

| まとめ | scene/017.png | Slide 17 | AI×3Dプリントの3段階まとめ |

コメント